Файл robots.txt для WordPress

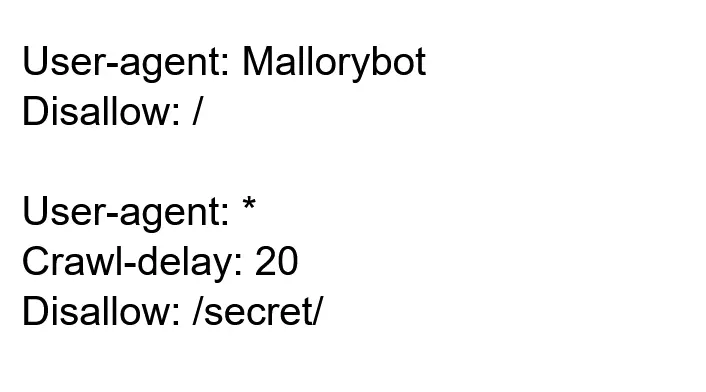

Robots.txt — это текстовый файл с инструкциями для поисковых роботов (краулеров), который указывает, какие страницы или разделы сайта можно сканировать, а какие — нет.

Основные функции данного файла:

- Управление индексацией: Запрещает роботам заходить в служебные разделы, такие как административная панель, корзина или личные кабинеты пользователей.

- Экономия краулингового бюджета: Ограничивает сканирование неважных или «тяжелых» файлов (скрипты, стили), чтобы роботы тратили ресурсы на индексацию основного контента.

- Предотвращение дублей: Помогает скрыть от поиска страницы с результатами фильтрации или поиска по сайту, которые создают повторяющийся контент.

- Указание пути к карте сайта: С помощью директивы

Sitemapфайл сообщает роботам адрес XML-карты для ускорения нахождения новых страниц. - Снижение нагрузки на сервер: Позволяет ограничить частоту запросов роботов к сайту через параметр

Crawl-delay(актуально для Яндекса).

Немного важных нюансов про robots.txt:

- Носит рекомендательный характер: Большинство поисковиков (Google, Яндекс) соблюдают правила, но вредоносные боты могут их игнорировать.

- Не скрывает страницу на 100%: Если на закрытую в robots.txt страницу ведет много внешних ссылок, она все равно может появиться в результатах поиска. Для полного исключения из индекса лучше использовать тег

noindex. - Должен быть в корне: Файл всегда располагается по адресу

вашсайт.ru/